数据挖掘分析之基石 数据预处理

在当今数据驱动的时代,数据挖掘与分析已成为洞察趋势、驱动决策的核心能力。从原始数据中直接提取有价值的信息,往往如同沙里淘金,充满挑战。这是因为现实世界中的数据大多是不完整的、不一致的、有噪声的。因此,数据预处理作为数据挖掘与分析流程中至关重要且不可或缺的第一步,其质量直接决定了后续所有分析模型的成败与深度。

一、数据预处理:为何是基石?

数据挖掘与分析的目标是发现隐藏在大量数据背后的模式、关联和知识。但原始数据,通常被称为“脏数据”,存在多种问题:

- 不完整:某些属性值缺失或记录不全。

- 不一致:数据格式、单位或编码不统一(如“男/女”与“M/F”混用)。

- 含噪声:包含错误或异常值(如年龄为“-1”或“200”)。

- 冗余:存在大量重复或不相关的信息。

直接将这样的数据输入挖掘算法,不仅会导致模型性能低下、结果不可靠,甚至可能产生误导性的结论。数据预处理的目的,正是通过一系列技术手段,将“脏数据”转化为高质量的“干净数据”,为后续的挖掘分析提供一个准确、一致、完整的输入。

二、数据预处理的核心步骤

一个系统化的数据预处理流程通常包含以下几个关键环节:

- 数据清洗:这是预处理的核心。

- 处理缺失值:根据情况,可以选择删除缺失记录、使用均值/中位数/众数填充,或利用算法进行预测填充。

- 平滑噪声数据:通过分箱、回归或聚类等方法识别并处理异常值,减少随机波动的影响。

- 纠正不一致:制定统一的数据标准,进行格式转换和逻辑一致性检查。

- 数据集成与转换:

- 数据集成:当数据来自多个来源时,需解决实体识别、属性冗余和数值冲突等问题,将它们合并成一致的数据存储。

- 数据转换:将数据转换为更适合挖掘的形式。常见方法包括:

- 规范化/标准化:将属性数据按比例缩放至特定区间(如[0,1])或具有零均值和单位方差,消除量纲影响。

- 属性构造:创建新的属性,以更好地捕捉数据特征(如用“收入/支出”构造“储蓄率”)。

- 离散化:将连续属性划分为区间,便于某些分类算法处理。

- 数据归约:在不损害分析结果的前提下,降低数据规模,提高挖掘效率。

- 维度归约:使用主成分分析(PCA)、特征选择等方法,减少不相关或冗余的属性。

- 数量归约:通过抽样、聚类或建立数据立方体,用较小的数据表示形式替换原始数据集。

- 数据压缩:使用编码方案减少数据存储空间。

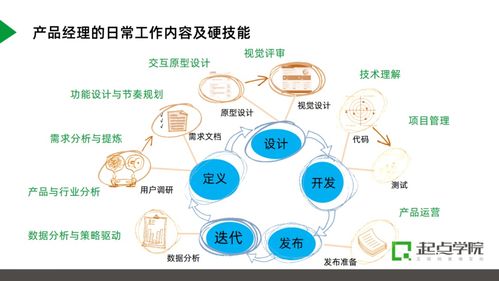

三、预处理与数据挖掘分析的闭环

数据预处理并非一次性工作,而是一个与后续分析紧密互动的迭代过程。一个典型的流程是:

- 对原始数据进行初步清洗和探索性分析,理解数据分布与问题。

- 应用预处理技术,得到初步的干净数据集。

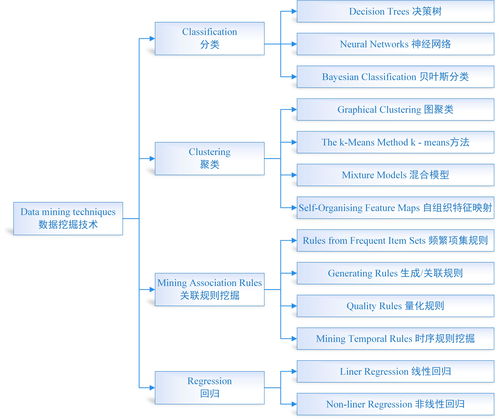

- 将其输入到数据挖掘模型(如分类、聚类、关联规则挖掘)中进行尝试。

- 根据模型的性能和反馈,重新审视预处理步骤,调整清洗策略、转换方法或特征选择,然后再次尝试。

这种闭环确保了预处理能够真正服务于分析目标。例如,为聚类分析准备的预处理(强调距离计算,需规范化)与为关联规则准备的预处理(处理事务型数据)侧重点可能不同。

结论

“垃圾进,垃圾出”在数据科学领域是至理名言。数据预处理虽然可能消耗整个数据挖掘项目60%-80%的时间和精力,但它绝非简单的“体力活”,而是凝聚了领域知识、统计洞察和技术判断的关键性分析阶段。它决定了数据这座矿山的矿石品位。只有经过精心、科学的预处理,数据挖掘与分析这把利刃,才能精准地剖开数据的表层,揭示出其中蕴含的真正宝藏——有价值、可操作的知识与洞察。因此,重视并精通数据预处理,是每一位数据分析师和数据科学家成功的基石。

如若转载,请注明出处:http://www.appzhiku.com/product/2.html

更新时间:2026-06-05 15:14:10